K Vecinos más Próximos KNN: tutorial en Excel

Este tutorial le mostrará cómo configurar e interpretar un aprendizaje de K vecinos más próximos (K Nearest Neighbors), (KNN) en Excel con el software XLSTAT.

¿No está seguro si esta función de aprendizaje automático supervisado es la que busca? Por favor, consulte esta guía.

Datos para ejecutar una clasificación por K vecinos más próximos (K Nearest Neighbors Classification)

Estos datos son un subconjunto del la base de datos propuesta por el Dr. William H. Wolberg (University of Wisconsin Hospitals, Madison). Cada fila corresponde a una muestra de tejido descrito por 9 variables (columnas C-K) medidas en pacientes que sufren de cáncer de mama benigno o maligno (clase definida en la columna B). El conjunto completo de datos se puede encontrar aquí.

Objetivo de este tutorial

El objetivo de este tutorial es utilizar el método de clasificación K vecinos más próximos (K nearest Neighbors, KNN) para determinar si un tejido mamario es benigno o maligno. Utilizaremos las 100 primeras observaciones como conjunto de datos de aprendizaje, y las últimas 20 observaciones como conjunto de datos de predicción. Por lo tanto, la clase de cáncer se eliminó a propósito en las últimas 20 observaciones. La clasificación por K vecinos más próximos se lleva a cabo mediante las siguientes variables explicativas de aprendizaje:

- Grosor Macizo: Las células benignas tienden a agruparse en monocapas, mientras que las células cancerosas a menudo se agrupan en multicapas.

- Uniformidad de Tamaño Celular: Las células cancerosas tienden a variar en tamaño.

- Uniformidad de la Forma Celular: Las células cancerosas tienden a variar en forma.

- Adherencia Marginal: Las células normales tienden a permanecer juntas. Las células cancerosas tienden a perder esta capacidad. Por lo tanto la pérdida de adherencia es un signo de malignidad.

- Tamaño Celular Epitelial Simple: Se relaciona con la uniformidad mencionada anteriormente. Las células epiteliales que se agrandan de manera significativa puede ser malignas.

- Núcleos Desnudos: Núcleos que no están rodeado de citoplasma (el resto de la célula). Se ven típicamente en los tumores benignos.

- Cromatina Suave: Describe una “textura” uniforme del núcleo observada en las células benignas. En células cancerosas la cromatina tiende a ser más gruesa.

- Nucleolos Normales: nucleolos son estructuras pequeñas que se ven en el núcleo. En las células normales, el nucleolo suele ser muy pequeño en el caso de ser visible. En las células cancerosas se vuelven más prominentes, ya veces son numerosos.

- Mitosis: división nuclear más citocinesis que produce dos hijas celulares idénticas. La variable dependiente corresponde a la clase de observación (benigno o maligno).

Configuración de una clasificación por K vecinos más próximos en XLSTAT

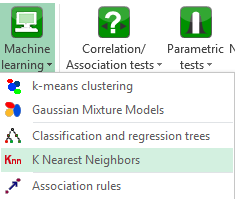

Una vez iniciado XLSTAT, elija el comando XLSTAT / Aprendizaje Automático / K vecinos más próximos.

Aparece el cuadro de diálogo K vecinos más próximos.

Seleccione la muestra de clases de aprendizaje en el campo Y / Variables cualitativas. Las variables explicativas relacionadas con la muestra de aprendizaje deben ser seleccionadas en el campo X / variables explicativas / cuantitativas. En el campo Conjunto de predicción, seleccione las variables asociadas a las 20 observaciones en la parte inferior del conjunto de datos. Fije el número de vecinos a 3.

En la pestaña Opciones, se pueden seleccionar y modificar varios parámetros del algoritmo. Por ejemplo, es posible especificar si desea utilizar las funciones del kernel o métricas (distancias) para calcular las similitudes.

Los cálculos empiezan una vez haya hecho clic en OK.

Interpretación de los resultados de una clasificación por K vecinos más próximos en XLSTAT

La primera tabla muestra las frecuencias y los porcentajes de las dos categorías de la variable dependiente en la muestra de aprendizaje (benigno, maligno). La segunda tabla muestra los estadísticos relacionados con las variables explicativas en la muestra de aprendizaje, y la tercera en la muestra de predicción.

La tasa de error estimada a través de la validación cruzada es de 0.04, lo cual es bueno.

Las predicciones de clase de la muestra de predicción se visualizan en primer lugar por clase...

…y luego por observación:

Seguidamente, para cada observación rastreada, se resumen la siguiente tabla las clases de los vecinos y sus respectivas distancias a la observación de seguimiento. A continuación, se muestra la información de seguimiento correspondiente a las dos primeras observaciones:

¿Ha sido útil este artículo?

- Sí

- No